Το Anthropic αναφέρει ότι μια κινεζική κρατική ομάδα απειλών, η οποία παρακολουθείται ως GTG-1002, πραγματοποίησε μια επιχείρηση κυβερνοκατασκοπείας που αυτοματοποιήθηκε σε μεγάλο βαθμό μέσω της κατάχρησης του μοντέλου Claude Code AI της εταιρείας.

Ωστόσο, οι ισχυρισμοί του Anthropic προκάλεσαν αμέσως εκτεταμένο σκεπτικισμό, με τους ερευνητές ασφαλείας και τους επαγγελματίες τεχνητής νοημοσύνης να αποκαλούν την αναφορά “φτιαγμένο» και κατηγορώντας την εταιρεία ότι υπερεκτίμησε το περιστατικό.

Άλλοι υποστήριξαν ότι η έκθεση υπερέβαλλε τι μπορούν να επιτύχουν ρεαλιστικά τα σημερινά συστήματα AI.

“Αυτό το Anthropic πράγμα είναι χάρμα μάρκετινγκ. Η τεχνητή νοημοσύνη είναι μια σούπερ ώθηση, αλλά δεν είναι το Skynet, δεν σκέφτεται, δεν είναι στην πραγματικότητα τεχνητή νοημοσύνη (αυτό είναι ένα πράγμα μάρκετινγκ στο οποίο βρήκαν οι άνθρωποι)”, δημοσίευσε ο ερευνητής κυβερνοασφάλειας Κάρτα Ντάνιελ.

Μεγάλο μέρος του σκεπτικισμού προέρχεται από το Anthropic που δεν παρέχει δείκτες συμβιβασμού (ΔΟΕ) πίσω από την εκστρατεία. Επιπλέον, τα αιτήματα της BleepingComputer για τεχνικές πληροφορίες σχετικά με τις επιθέσεις δεν απαντήθηκαν.

Οι επιθέσεις αξιώσεων ήταν κατά 80-90% αυτοματοποιημένες με AI

Παρά την κριτική, η Anthropic ισχυρίζεται ότι το περιστατικό αντιπροσωπεύει την πρώτη δημόσια τεκμηριωμένη περίπτωση δραστηριότητας αυτόνομης εισβολής μεγάλης κλίμακας που διεξήχθη από μοντέλο AI.

Η επίθεση, η οποία Λέει ο Anthropic διακόπηκε στα μέσα Σεπτεμβρίου 2025, χρησιμοποίησε το μοντέλο του Κώδικα Claude για να στοχεύσει 30 οντότητες, συμπεριλαμβανομένων μεγάλων εταιρειών τεχνολογίας, χρηματοπιστωτικών ιδρυμάτων, κατασκευαστών χημικών και κυβερνητικών φορέων.

Αν και η εταιρεία λέει ότι μόνο ένας μικρός αριθμός εισβολών πέτυχε, επισημαίνει την επιχείρηση ως την πρώτη του είδους της σε αυτήν την κλίμακα, με την τεχνητή νοημοσύνη να διεξάγει αυτόνομα σχεδόν όλες τις φάσεις της ροής εργασιών της κυβερνοκατασκοπείας.

“Ο ηθοποιός πέτυχε αυτό που πιστεύουμε ότι είναι η πρώτη τεκμηριωμένη περίπτωση κυβερνοεπίθεσης που εκτελέστηκε σε μεγάλο βαθμό χωρίς ανθρώπινη παρέμβαση σε κλίμακα – η τεχνητή νοημοσύνη ανακάλυψε αυτόνομα τρωτά σημεία… τα εκμεταλλεύτηκε σε ζωντανές λειτουργίες και στη συνέχεια πραγματοποίησε ένα ευρύ φάσμα δραστηριοτήτων μετά την εκμετάλλευση”, εξηγεί η Anthropic. έκθεση.

«Το πιο σημαντικό είναι ότι αυτό σηματοδοτεί την πρώτη τεκμηριωμένη περίπτωση πράκτορα AI που αποκτά με επιτυχία πρόσβαση σε επιβεβαιωμένους στόχους υψηλής αξίας για συλλογή πληροφοριών, συμπεριλαμβανομένων μεγάλων εταιρειών τεχνολογίας και κυβερνητικών υπηρεσιών».

.jpg)

Πηγή: Anthropic

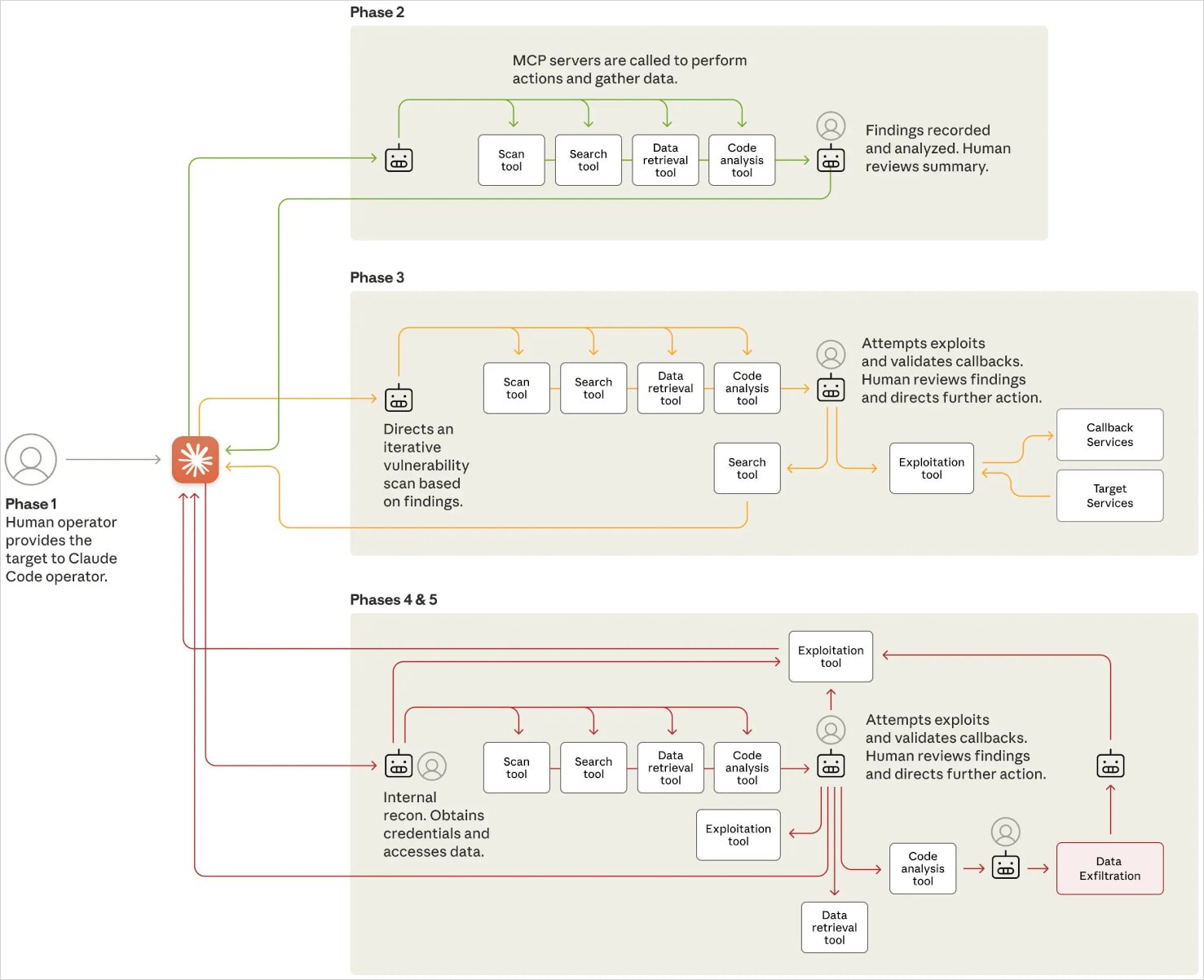

Η Anthropic αναφέρει ότι οι Κινέζοι χάκερ κατασκεύασαν ένα πλαίσιο που χειραγωγούσε τον Claude ώστε να ενεργεί ως αυτόνομος πράκτορας εισβολής στον κυβερνοχώρο, αντί να λαμβάνει απλώς συμβουλές ή να χρησιμοποιεί το εργαλείο για τη δημιουργία θραυσμάτων πλαισίων επίθεσης, όπως φαίνεται σε προηγούμενα περιστατικά.

Το σύστημα χρησιμοποίησε το Claude σε συνδυασμό με τυπικά βοηθητικά προγράμματα δοκιμών διείσδυσης και μια υποδομή βασισμένη στο Model Context Protocol (MCP) για σάρωση, εκμετάλλευση και εξαγωγή πληροφοριών χωρίς άμεση ανθρώπινη επίβλεψη για τις περισσότερες εργασίες.

Οι ανθρώπινοι χειριστές επενέβησαν μόνο σε κρίσιμες στιγμές, όπως η έγκριση κλιμακώσεων ή η αναθεώρηση δεδομένων για διήθηση, που η Anthropic εκτιμά ότι είναι μόλις 10-20% του επιχειρησιακού φόρτου εργασίας.

Η επίθεση διεξήχθη σε έξι διακριτές φάσεις, οι οποίες συνοψίζονται ως εξής:

- Φάση 1 – Οι ανθρώπινοι χειριστές επέλεξαν στόχους υψηλής αξίας και χρησιμοποίησαν τακτικές παιχνιδιού ρόλων για να εξαπατήσουν τον Claude να πιστέψει ότι εκτελούσε εξουσιοδοτημένες εργασίες ασφάλειας στον κυβερνοχώρο, παρακάμπτοντας τους ενσωματωμένους περιορισμούς ασφαλείας.

- Φάση 2 – Ο Claude σάρωσε αυτόνομα την υποδομή δικτύου σε πολλούς στόχους, ανακάλυψε υπηρεσίες, ανέλυσε μηχανισμούς ελέγχου ταυτότητας και εντόπισε ευάλωτα τελικά σημεία. Διατήρησε ξεχωριστά επιχειρησιακά πλαίσια, επιτρέποντας παράλληλες επιθέσεις χωρίς ανθρώπινη επίβλεψη.

- Φάση 3 – Η τεχνητή νοημοσύνη δημιούργησε προσαρμοσμένα ωφέλιμα φορτία, πραγματοποίησε δοκιμές εξ αποστάσεως και επικύρωσε ευπάθειες. Δημιούργησε λεπτομερείς αναφορές για ανθρώπινη ανασκόπηση, με τους ανθρώπους να παρεμβαίνουν μόνο για να εγκρίνουν την κλιμάκωση στην ενεργό εκμετάλλευση.

- Φάση 4 – Ο Claude εξήγαγε δεδομένα ελέγχου ταυτότητας από διαμορφώσεις συστήματος, δοκίμασε την πρόσβαση διαπιστευτηρίων και χαρτογράφησε εσωτερικά συστήματα. Πλοηγούσε ανεξάρτητα σε εσωτερικά δίκτυα, έχοντας πρόσβαση σε API, βάσεις δεδομένων και υπηρεσίες, ενώ οι άνθρωποι εξουσιοδοτούσαν μόνο τις πιο ευαίσθητες εισβολές.

- Φάση 5 – Ο Claude χρησιμοποίησε την πρόσβασή του σε βάσεις δεδομένων ερωτημάτων, εξάγει ευαίσθητα δεδομένα και προσδιορίζει την αξία νοημοσύνης. Κατηγοριοποίησε τα ευρήματα, δημιούργησε επίμονες κερκόπορτες και δημιούργησε συνοπτικές αναφορές, που απαιτούσαν ανθρώπινη έγκριση μόνο για την τελική εξαγωγή δεδομένων.

- Φάση 6 – Καθ’ όλη τη διάρκεια της καμπάνιας, ο Claude τεκμηρίωσε κάθε βήμα σε δομημένη μορφή, συμπεριλαμβανομένων στοιχείων ενεργητικού, διαπιστευτηρίων, μεθόδων εκμετάλλευσης και εξαγόμενων δεδομένων. Αυτό επέτρεψε την απρόσκοπτη μεταβίβαση μεταξύ ομάδων παραγόντων απειλών και υποστήριξε τη μακροπρόθεσμη επιμονή σε παραβιασμένα περιβάλλοντα.

Πηγή: Anthropic

Η Anthropic εξηγεί περαιτέρω ότι η καμπάνια βασίστηκε περισσότερο σε εργαλεία ανοιχτού κώδικα παρά σε εξατομικευμένο κακόβουλο λογισμικό, αποδεικνύοντας ότι η τεχνητή νοημοσύνη μπορεί να αξιοποιήσει άμεσα διαθέσιμα εργαλεία για τη διεξαγωγή αποτελεσματικών επιθέσεων.

Ωστόσο, ο Claude δεν ήταν άψογος, καθώς, σε ορισμένες περιπτώσεις, παρήγαγε ανεπιθύμητες «παραισθήσεις», κατασκευασμένα αποτελέσματα και υπερεκτιμημένα ευρήματα.

Απαντώντας σε αυτήν την κατάχρηση, η Anthropic απαγόρευσε τους προσβλητικούς λογαριασμούς, βελτίωσε τις δυνατότητες ανίχνευσης και μοιράστηκε πληροφορίες με συνεργάτες για να βοηθήσει στην ανάπτυξη νέων μεθόδων ανίχνευσης για εισβολές που βασίζονται σε τεχνητή νοημοσύνη.

VIA: bleepingcomputer.com