Ο Διευθύνων Σύμβουλος της NVIDIA, Jensen Huang, μπορεί να είχε κάνει στην ομάδα του chip του ένα «χριστουγεννιάτικο» δώρο που κανείς δεν θα περίμενε, καθώς αναφέρθηκε ότι η Team Green είχε συνάψει συμφωνία με την Groq, μια εταιρεία που κατασκευάζει εξειδικευμένο υλικό AI. Και αυτά δεν είναι απλά τσιπ. θα μπορούσαν να αποτελέσουν μια πύλη για την NVIDIA να κυριαρχεί σε φόρτους εργασίας κατηγορίας συμπερασμάτων.

Για να καταλάβουμε γιατί αυτό είναι ένα «Masterclass», πρέπει να εξετάσουμε δύο ξεχωριστά μέτωπα μάχης: τα ρυθμιστικά κενά που μόλις χρησιμοποίησε ο Jensen και την κυριαρχία του υλικού που έχει εξασφαλίσει.

Μοιάζει με απόκτηση. Μυρίζει σαν απόκτημα. Αλλά στα χαρτιά, είναι απλώς μια «μη αποκλειστική» ρύθμιση

Το CNBC ήταν το πρώτος που έκανε αναφορά για αυτήν την εξέλιξηυποστηρίζοντας ότι η NVIDIA «αγοράζει» την Groq Inc. σε μια συμφωνία mega 20 δισεκατομμυρίων δολαρίων, σηματοδοτώντας τη μεγαλύτερη εξαγορά από την Jensen. Αυτό οδήγησε σε μια τεράστια πυρκαγιά στη βιομηχανία, όπου ορισμένοι πρότειναν ότι οι ρυθμιστικές έρευνες θα εμπόδιζαν την κίνηση, ενώ άλλοι ισχυρίστηκαν ότι ήταν το τέλος του Groq. Ωστόσο, αργότερα ο Γκροκ εξέδωσε επίσημα ανακοίνωση στον ιστότοπό της, δηλώνοντας ότι έχει συνάψει «συμφωνία μη αποκλειστικής άδειας χρήσης» με τη NVIDIA, παραχωρώντας στον γίγαντα της τεχνητής νοημοσύνης πρόσβαση στην τεχνολογία συμπερασμάτων.

Σκοπεύουμε να ενσωματώσουμε τους επεξεργαστές χαμηλής καθυστέρησης της Groq στην εργοστασιακή αρχιτεκτονική της NVIDIA AI, επεκτείνοντας την πλατφόρμα ώστε να εξυπηρετεί ένα ακόμη ευρύτερο φάσμα συμπερασμάτων τεχνητής νοημοσύνης και φόρτου εργασίας σε πραγματικό χρόνο. Ενώ προσθέτουμε ταλαντούχους υπαλλήλους στις τάξεις μας και αδειοδοτούμε την IP της Groq, δεν εξαγοράζουμε την Groq ως εταιρεία.

– Ο Διευθύνων Σύμβουλος της NVIDIA, Jensen Huang σε εσωτερικό mail

Ως εκ τούτου, η αντίληψη περί συγχώνευσης, τουλάχιστον στα χαρτιά, ακυρώθηκε μετά τη δήλωση Groq. Τώρα, η σειρά των γεγονότων μου φαίνεται αρκετά ενδιαφέρουσα, ειδικά επειδή το μόνο πράγμα που λείπει από αυτή τη συμφωνία για να θεωρηθεί εξαγορά πλήρους κλίμακας είναι η αποφυγή αναφοράς της στις επίσημες αποκαλύψεις.

Αυτή είναι μια κλασική κίνηση “Αντίστροφη ενοικίαση Acqui” από την NVIDIA εδώ, και αν κάποιος δεν ξέρει τι σημαίνει αυτό, είναι μια κίνηση από το playbook της Microsoft, όπου ο τεχνολογικός γίγαντας το 2024 ανακοίνωσε μια συμφωνία με την Inflection αξίας 653 εκατομμυρίων δολαρίων, η οποία περιλαμβάνει τους Mustafa Suleyman και την Karén Simonya που εντάχθηκαν στην στρατηγική της Microsoft.

Το Reverse Acqui-hire μεταφράζεται σε μια εταιρεία που προσλαμβάνει βασικά ταλέντα από μια startup και αφήνει πίσω της μια «ελάχιστη» εταιρική δομή, η οποία τελικά αποτρέπει μια τέτοια κίνηση από τη συγχώνευση. Τώρα, φαίνεται ότι ο Jensen κατάφερε να εκτελέσει κάτι παρόμοιο για να αποφύγει να βρεθεί υπό την έρευνα της FTC, καθώς διαμορφώνοντας τη συμφωνία Groq ως “μη αποκλειστική συμφωνία αδειοδότησης”, η NVIDIA είναι ουσιαστικά εκτός του πεδίου εφαρμογής της Νόμος Hart-Scott-Rodino (HSR).. Είναι ενδιαφέρον ότι ο Groq αναφέρει ότι το GroqCloud θα συνεχίσει να λειτουργεί, αλλά μόνο ως «γυμνή δομή».

Αυτό που συνέβη είναι ότι η NVIDIA απέκτησε το ταλέντο και την IP του Groq για 20 δισεκατομμύρια δολάρια που αναφέρθηκαν, κατάφερε να ξεφύγει από τις ρυθμιστικές έρευνες, οι οποίες της επέτρεψαν να εκτελέσουν τη συμφωνία μέσα σε λίγες μέρες. Και όταν μιλάτε για το υλικό στο οποίο έχουν πλέον πρόσβαση, αυτό είναι το πιο ενδιαφέρον μέρος της συμφωνίας NVIDIA-Groq.

Η αρχιτεκτονική LPU του Groq και γιατί θα μπορούσε να είναι το κομμάτι που λείπει για την NVIDIA που κυριαρχεί στην κατηγορία συμπερασμάτων

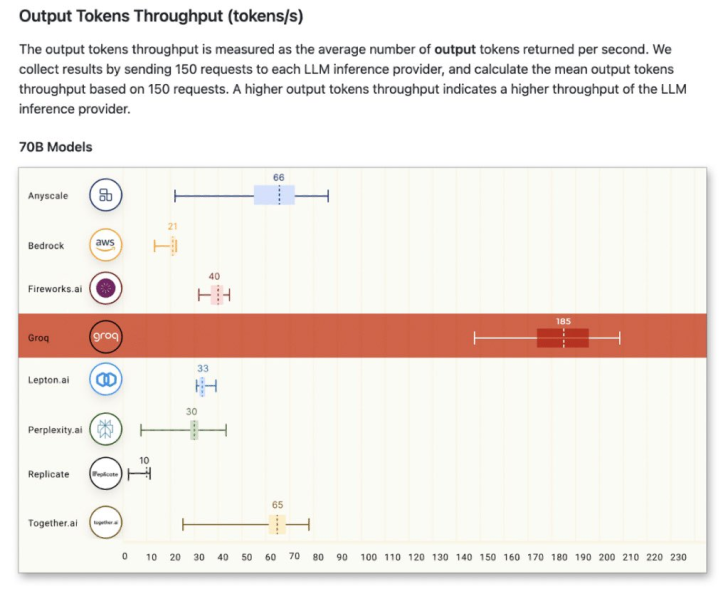

Αυτό είναι το τμήμα που είμαι πολύ ενθουσιασμένος να συζητήσω, καθώς το Groq διαθέτει ένα οικοσύστημα υλικού που θα μπορούσε να επαναλάβει την επιτυχία της NVIDIA στην εποχή της εκπαίδευσης, και θα το δικαιολογήσω επίσης εκ των προτέρων. Ο κλάδος της τεχνητής νοημοσύνης έχει εξελιχθεί δραματικά τους τελευταίους μήνες όσον αφορά την υπολογιστική ζήτηση. Ενώ εταιρείες όπως η OpenAI, η Meta, η Google και άλλες ασχολούνται με την εκπαίδευση μοντέλων αιχμής, επιδιώκουν επίσης να έχουν μια ισχυρή στοίβα συμπερασμάτων επί του σκάφους, καθώς εκεί κερδίζουν χρήματα οι περισσότεροι υπερκλιμακωτές.

Όταν η Google ανακοίνωσε τα Ironwood TPU, η βιομηχανία το διαφημίστηκε ως επιλογή που εστιάζει σε συμπεράσματα και τα ASIC προβλήθηκαν ως αντικατάσταση της NVIDIA, κυρίως επειδή υπήρχαν ισχυρισμοί ότι ο Jensen δεν είχε ακόμη προσφέρει μια λύση που κυριαρχούσε στην απόδοση συμπερασμάτων. Έχουμε το Rubin CPX, αλλά θα το συζητήσω αργότερα. Όταν μιλάμε για συμπέρασμα, ο υπολογισμός της ζήτησης αλλάζει δραματικά, καθώς με την εκπαίδευση, ο κλάδος απαιτεί απόδοση σε καθυστέρηση και υψηλή αριθμητική ένταση, γι’ αυτό οι σύγχρονοι επιταχυντές ενισχύονται με HBM και τεράστιους πυρήνες τανυστή.

Δεδομένου ότι οι υπερκλιμακωτές στρέφονται προς την εξαγωγή συμπερασμάτων, απαιτούν τώρα μια γρήγορη, προβλέψιμη και προοδευτική μηχανή εκτέλεσης, καθώς η καθυστέρηση απόκρισης είναι το κύριο σημείο συμφόρησης. Για να φέρουν σε γρήγορους υπολογισμούς, εταιρείες όπως η NVIDIA έχουν στοχεύσει φόρτους εργασίας, όπως συμπέρασμα μαζικού περιβάλλοντος (προπλήρωση και γενική εξαγωγή συμπερασμάτων) με το Rubin CPX ή την Google, η οποία διαφημίζεται ως μια πιο αποδοτική επιλογή ενέργειας με τις TPU. Ωστόσο, όσον αφορά την αποκωδικοποίηση, δεν υπάρχουν πολλές διαθέσιμες επιλογές.

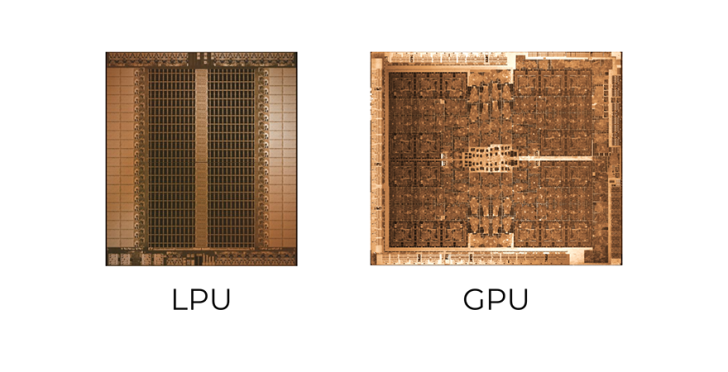

Η αποκωδικοποίηση αναφέρεται στη φάση συμπερασμάτων δημιουργίας διακριτικών σε ένα μοντέλο μετασχηματιστή και γίνεται όλο και πιο σημαντική ως βασική πτυχή της ταξινόμησης του φόρτου εργασίας της τεχνητής νοημοσύνης. Η αποκωδικοποίηση απαιτεί ντετερμινιστική και χαμηλής καθυστέρησης συμπεριφορά και δεδομένων των περιορισμών που επιφέρει η χρήση του HBM (λανθάνουσα κατάσταση και ισχύς) σε περιβάλλοντα εξαγωγής συμπερασμάτων, το Groq έχει κάτι μοναδικό εκεί έξω, που είναι η χρήση του SRAM (Static RAM). Τώρα είναι καιρός να μιλήσουμε για τα LPU, τώρα που έχω ξεκαθαρίσει γιατί υπάρχει ανάγκη για μια νέα ματιά στον υπολογισμό συμπερασμάτων.

LPU του Groq: Συνδυάστε την αποκωδικοποίηση υψηλής καθυστέρησης και κερδίστε άλλα σε προβλεψιμότητα ανά διακριτικό

Τα LPU είναι δημιούργημα του πρώην CEO της Groq, Jonathan Ross, ο οποίος, παρεμπιπτόντως, εντάσσεται στην NVIDIA μετά την πρόσφατη συμφωνία. Ο Ross είναι γνωστός για τη δουλειά του με τους TPU της Google, επομένως μπορούμε να είμαστε σίγουροι ότι η Team Green αποκτά ένα σημαντικό περιουσιακό στοιχείο εσωτερικά. Τα LPU (Μονάδες Επεξεργασίας Γλώσσας) είναι η λύση της Groq για φόρτους εργασίας κατηγορίας συμπερασμάτων και η εταιρεία διακρίνεται από άλλες βασιζόμενη σε δύο βασικά στοιχήματα. Το πρώτο είναι η ντετερμινιστική εκτέλεση και η on-die SRAM ως κύρια αποθήκευση βάρους. Αυτή είναι η προσέγγιση του Groq για την επίτευξη ταχύτητας διασφαλίζοντας προβλεψιμότητα.

Η Groq έχει παρουσιάσει στο παρελθόν δύο κορυφαίες λύσεις: την GroqChip και την GroqCard που βασίζεται σε συνεργάτες. Με βάση τις πληροφορίες που δημοσιεύονται σε επίσημα έγγραφα, αυτά τα τσιπ διαθέτουν 230 MB on-die SRAM με έως και 80 TB/s εύρους ζώνης μνήμης on-die. Η χρήση της SRAM είναι ένα από τα βασικά πλεονεκτήματα των LPU, καθώς επιτρέπει κατά τάξεις μεγέθους χαμηλότερο λανθάνοντα χρόνο. Με το HBM, όταν λαμβάνετε υπόψη τον λανθάνοντα χρόνο που προκαλείται από την πρόσβαση DRAM και τις ουρές ελεγκτή μνήμης, η SRAM κερδίζει με σημαντικό περιθώριο. Η On-die SRAM επιτρέπει στην Groq να επιτύχει δεκάδες terabyte ανά δευτερόλεπτο εσωτερικού εύρους ζώνης, επιτρέποντας στην εταιρεία να προσφέρει κορυφαία απόδοση.

Η SRAM δίνει επίσης τη δυνατότητα στο Groq να προσφέρει μια πλατφόρμα εξοικονόμησης ενέργειας, καθώς η πρόσβαση σε SRAM απαιτεί σημαντικά χαμηλότερη ενέργεια ανά bit και εξαλείφει τα γενικά έξοδα PHY. Και, στην αποκωδικοποίηση, τα LPU οδηγούν σε σημαντική βελτίωση της ενέργειας ανά διακριτικό, κάτι που είναι σημαντικός παράγοντας, δεδομένου ότι ο φόρτος εργασίας αποκωδικοποίησης είναι έντασης μνήμης. Αυτή είναι η αρχιτεκτονική πτυχή των LPU, και παρόλο που μπορεί να φαίνεται σημαντική, είναι μόνο ένα μέρος της απόδοσης των LPU. Το άλλο στοιχείο είναι η αξιοποίηση ντετερμινιστικών κύκλων, που επικεντρώνεται στον προγραμματισμό χρόνου μεταγλώττισης για την εξάλειψη των χρονικών διακυμάνσεων μεταξύ των πυρήνων.

Ο προγραμματισμός χρόνου μεταγλώττισης διασφαλίζει ότι οι «καθυστερήσεις» εντός των αγωγών αποκωδικοποίησης είναι ανύπαρκτες, και αυτός είναι ένας σημαντικός παράγοντας, καθώς επιτρέπει την τέλεια χρήση του αγωγού, επιτρέποντας πολύ υψηλότερη απόδοση σε σχέση με τους σύγχρονους επιταχυντές. Συνοψίζοντας, οι LPU είναι αφιερωμένες εξ ολοκλήρου σε αυτό που χρειάζονται οι υπερκλιμακωτές για συμπέρασμα, αλλά υπάρχει μια προειδοποίηση που η βιομηχανία αγνοεί επί του παρόντος. Τα LPU είναι πραγματικό και αποτελεσματικό υλικό εξαγωγής συμπερασμάτων, αλλά είναι εξαιρετικά εξειδικευμένα και δεν έχουν γίνει ακόμη μια βασική προεπιλεγμένη πλατφόρμα, και εκεί έρχεται η NVIDIA.

Αν και δεν γνωρίζουμε ακόμη πώς μπορούν να ενσωματωθούν τα LPU στις προσφορές της NVIDIA, ένας τρόπος για να το κάνουμε είναι να τα προσφέρουμε ως μέρος συστημάτων συμπερασμάτων σε κλίμακα rack (παρόμοια με το Rubin CPX), σε συνδυασμό με υποδομή δικτύωσης. Αυτό θα επέτρεπε στις GPU να χειρίζονται prefill/long-context, με τις LPU να επικεντρώνονται στην αποκωδικοποίηση, πράγμα που σημαίνει ουσιαστικά ότι στις εργασίες εξαγωγής συμπερασμάτων, η NVIDIA έχει τακτοποιήσει τα πάντα. Αυτό θα μπορούσε να μετατρέψει την εικόνα των LPU από μια πειραματική επιλογή σε μια τυπική μέθοδο συμπερασμάτων, διασφαλίζοντας την ευρεία υιοθέτησή τους μεταξύ των υπερκλιμακωτών.

Δεν υπάρχει αμφιβολία ότι αυτή η συμφωνία σηματοδοτεί ένα από τα μεγαλύτερα επιτεύγματα για την NVIDIA όσον αφορά την ανάπτυξη του χαρτοφυλακίου της, καθώς όλοι οι δείκτες δείχνουν ότι η επόμενη επιλογή θα είναι η εξαγωγή συμπερασμάτων για την οποία θα μιλήσει η NVIDIA και τα LPU θα αποτελούν βασικό μέρος της στρατηγικής της εταιρείας για αυτόν τον τομέα φόρτου εργασίας AI. Λοιπόν, αυτό είναι για μια εικόνα της συμφωνίας Groq, και ο Jensen σίγουρα έχει δώσει ένα καταπληκτικό δώρο στους ανθρώπους της NVIDIA, καθώς και σε ανθρώπους με γνώσεις τεχνολογίας όπως εγώ.

Ακολουθώ Wccftech στο Google για να λαμβάνετε περισσότερες από τις ειδήσεις μας στις ροές δεδομένων σας.

VIA: wccftech.com