Οι ερευνητές της Apple ανέπτυξαν ένα μοντέλο AI που βελτιώνει δραματικά τις εξαιρετικά σκοτεινές φωτογραφίες ενσωματώνοντας ένα μοντέλο εικόνας που βασίζεται στη διάχυση απευθείας στον αγωγό επεξεργασίας εικόνας της κάμερας, επιτρέποντάς της να ανακτήσει λεπτομέρειες από ακατέργαστα δεδομένα αισθητήρα που κανονικά θα χάνονταν. Να πώς το έκαναν.

Το πρόβλημα με τις φωτογραφίες σε ακραίο χαμηλό φωτισμό

Πιθανότατα έχετε τραβήξει μια φωτογραφία σε πολύ σκοτεινές συνθήκες, που οδήγησε σε μια εικόνα γεμάτη με κοκκώδη, ψηφιακό θόρυβο.

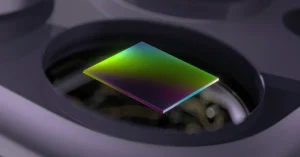

Αυτό συμβαίνει όταν ο αισθητήρας εικόνας δεν συλλαμβάνει αρκετό φως.

Για να προσπαθήσουν να το αναπληρώσουν, εταιρείες όπως η Apple έχουν εφαρμόσει αλγόριθμους επεξεργασίας εικόνας που έχουν επικριθεί για τη δημιουργία υπερβολικά ομαλού εφέ που μοιάζει με ελαιογραφία, όπου η λεπτομέρεια εξαφανίζεται ή ανακατασκευάζεται σε κάτι μόλις αναγνωρίσιμο ή αναγνώσιμο.

Εισαγάγετε το DarkDiff

Για να αντιμετωπίσουν αυτό το πρόβλημα, ερευνητές από την Apple και το Πανεπιστήμιο Purdue ανέπτυξαν ένα μοντέλο που ονομάζεται DarkDiff. Δείτε πώς το παρουσιάζουν σε μια μελέτη που ονομάζεται DarkDiff: Προώθηση ακατέργαστης βελτίωσης χαμηλού φωτισμού με επανατοποθέτηση μοντέλων διάχυσης για ISP κάμερας:

Η φωτογραφία υψηλής ποιότητας σε συνθήκες ακραίου χαμηλού φωτισμού είναι προκλητική αλλά εντυπωσιακή για τις ψηφιακές φωτογραφικές μηχανές. Με προηγμένο υπολογιστικό υλικό, οι παραδοσιακοί αλγόριθμοι του επεξεργαστή σήματος εικόνας της κάμερας (ISP) αντικαθίστανται σταδιακά από αποτελεσματικά δίκτυα σε βάθος που ενισχύουν πιο έξυπνα τις θορυβώδεις ακατέργαστες εικόνες. Ωστόσο, τα υπάρχοντα μοντέλα που βασίζονται σε παλινδρόμηση συχνά ελαχιστοποιούν τα σφάλματα εικονοστοιχείων και έχουν ως αποτέλεσμα την υπερβολική εξομάλυνση των φωτογραφιών χαμηλού φωτισμού ή των βαθιών σκιών. Πρόσφατες εργασίες προσπάθησαν να αντιμετωπίσουν αυτόν τον περιορισμό εκπαιδεύοντας ένα μοντέλο διάχυσης από την αρχή, ωστόσο αυτά τα μοντέλα εξακολουθούν να δυσκολεύονται να ανακτήσουν ευκρινείς λεπτομέρειες εικόνας και ακριβή χρώματα. Εισάγουμε ένα νέο πλαίσιο για τη βελτίωση των ακατέργαστων εικόνων χαμηλού φωτισμού, αναθέτοντας εκ νέου προ-εκπαιδευμένα μοντέλα γενετικής διάχυσης με τον ISP της κάμερας. Εκτεταμένα πειράματα αποδεικνύουν ότι η μέθοδός μας ξεπερνά την τελευταία λέξη της τεχνολογίας σε αντιληπτική ποιότητα σε τρία προκλητικά σημεία αναφοράς ακατέργαστων εικόνων χαμηλού φωτισμού.

Με άλλα λόγια, αντί να εφαρμόσουν την τεχνητή νοημοσύνη στο στάδιο της μετα-επεξεργασίας, ανέθεσαν ξανά το Stable Diffusion (ένα μοντέλο ανοιχτού κώδικα εκπαιδευμένο σε εκατομμύρια εικόνες) για να καταλάβουν ποιες λεπτομέρειες πρέπει υπάρχουν σε σκοτεινές περιοχές των φωτογραφιών λαμβάνοντας υπόψη το γενικό τους πλαίσιο και τις ενσωματώνουν στον αγωγό επεξεργασίας σήματος εικόνας.

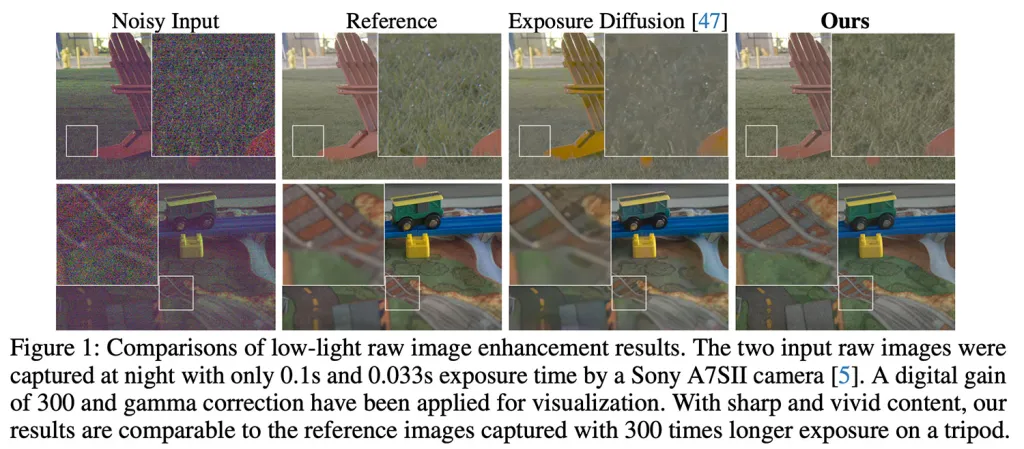

Στην πραγματικότητα, η προσέγγισή τους εισάγει έναν μηχανισμό που υπολογίζει την προσοχή σε εντοπισμένα μπαλώματα εικόνας, που βοηθά στη διατήρηση των τοπικών δομών και μετριάζει τις ψευδαισθήσεις όπως στην παρακάτω εικόνα, όπου το AI ανακατασκευής αλλάζει εντελώς το περιεχόμενο της εικόνας.

Με αυτήν την προσέγγιση, ο ISP της φωτογραφικής μηχανής εξακολουθεί να χειρίζεται την πρώιμη επεξεργασία που απαιτείται για να κατανοήσει τα ακατέργαστα δεδομένα του αισθητήρα, συμπεριλαμβανομένων βημάτων όπως η ισορροπία λευκού και η απομόνωση. Στη συνέχεια, το DarkDiff λειτουργεί σε αυτήν τη γραμμική εικόνα RGB, αφαιρώντας την από θόρυβο και δημιουργώντας απευθείας την τελική εικόνα sRGB.

Το DarkDiff χρησιμοποιεί επίσης μια τυπική τεχνική διάχυσης που ονομάζεται καθοδήγηση χωρίς ταξινομητή, η οποία ουσιαστικά ελέγχει πόσο έντονα το μοντέλο πρέπει να ακολουθεί την εικόνα εισόδου, σε σχέση με τις οπτικές προτεραιότητες που έχει μάθει.

Με χαμηλότερη καθοδήγηση, το μοντέλο παράγει πιο ομαλά μοτίβα, ενώ η αυξανόμενη καθοδήγηση το ενθαρρύνει να δημιουργεί πιο ευκρινείς υφές και λεπτότερες λεπτομέρειες (που με τη σειρά του αυξάνει επίσης τον κίνδυνο δημιουργίας ανεπιθύμητων τεχνουργημάτων ή παραισθησιακού περιεχομένου).

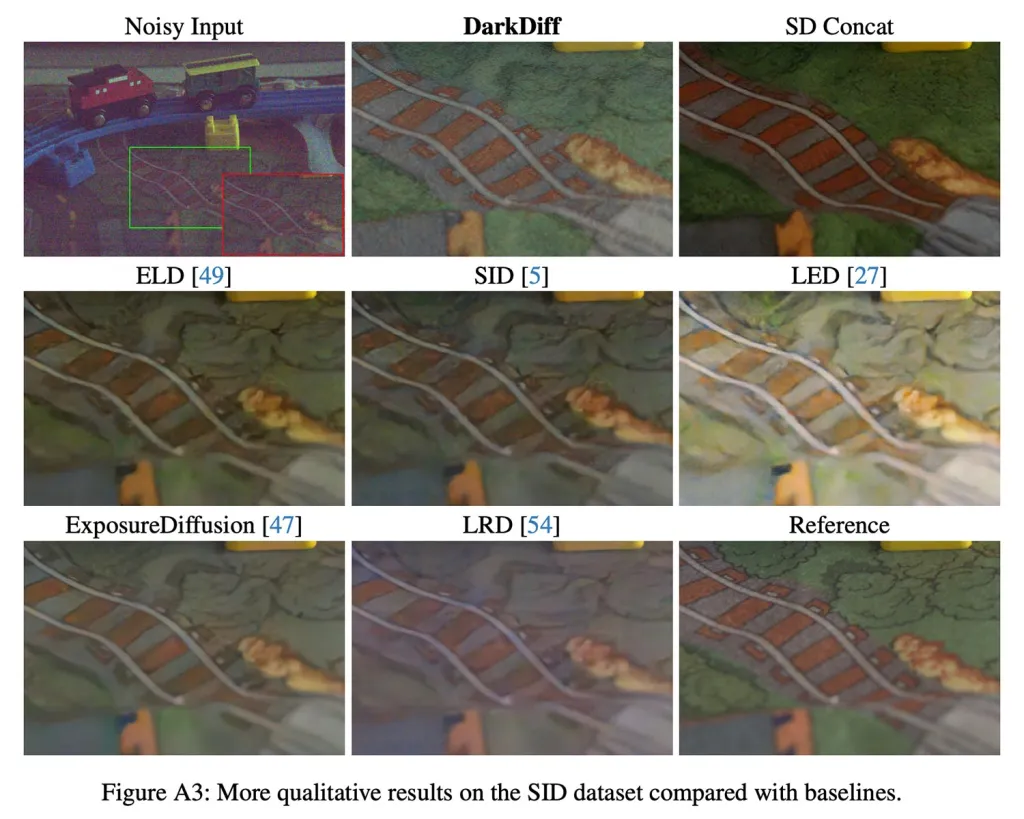

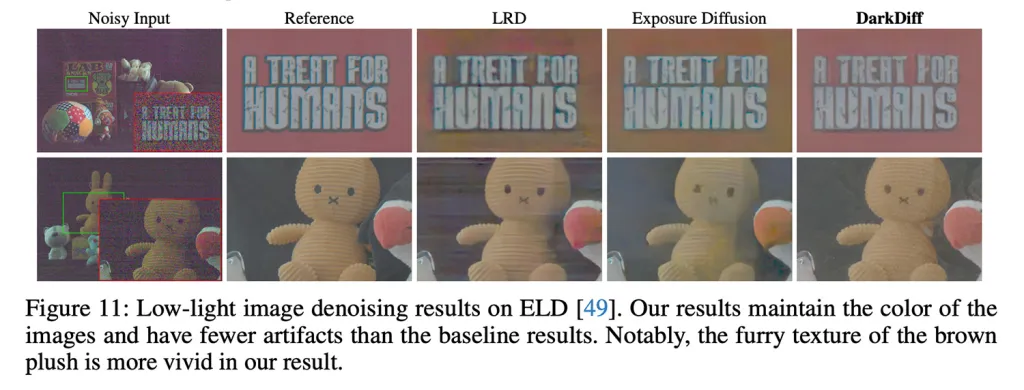

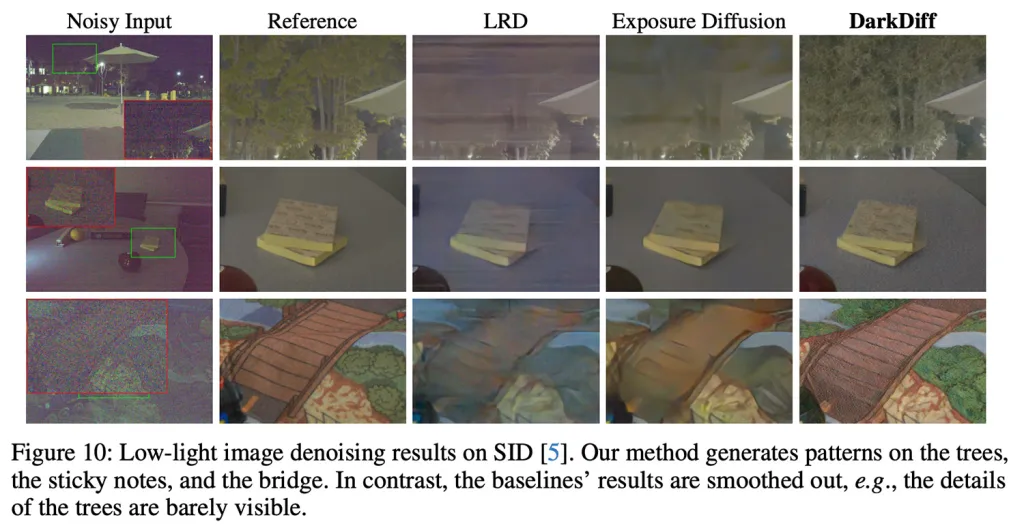

Για να δοκιμάσουν το DarkDiff, οι ερευνητές χρησιμοποίησαν πραγματικές φωτογραφίες που τραβήχτηκαν σε εξαιρετικά χαμηλό φωτισμό με κάμερες όπως η Sony A7SII, συγκρίνοντας τα αποτελέσματα με άλλα μοντέλα ακατέργαστης βελτίωσης και βασικές γραμμές που βασίζονται στη διάχυση, συμπεριλαμβανομένου του ExposureDiffusion.

Οι δοκιμαστικές εικόνες τραβήχτηκαν τη νύχτα με χρόνο έκθεσης μικρότερο από 0,033 δευτερόλεπτα και οι βελτιωμένες εκδόσεις του DarkDiff συγκρίθηκαν με φωτογραφίες αναφοράς που τραβήχτηκαν με 300 φορές μεγαλύτερη έκθεση σε τρίποδο.

Εδώ είναι μερικά από τα αποτελέσματα (τα οποία σας ενθαρρύνουμε να δείτε σε πλήρη ποιότητα στην αρχική μελέτη):

Το DarkDiff δεν είναι χωρίς προβλήματα

Οι ερευνητές σημειώνουν ότι η επεξεργασία τους που βασίζεται στο AI είναι σημαντικά πιο αργή από τις παραδοσιακές μεθόδους και πιθανότατα θα απαιτούσε επεξεργασία cloud για να καλύψει τις υψηλές υπολογιστικές απαιτήσεις που θα εξαντλούσαν γρήγορα την μπαταρία εάν εκτελούνταν τοπικά σε ένα τηλέφωνο. Επιπλέον, σημειώνουν επίσης περιορισμούς με την αναγνώριση μη αγγλικού κειμένου σε σκηνές χαμηλού φωτισμού.

Είναι επίσης σημαντικό να σημειωθεί ότι πουθενά στη μελέτη δεν προτείνεται ότι το DarkDiff θα φτάσει σύντομα στα iPhone. Ωστόσο, η εργασία καταδεικνύει τη συνεχιζόμενη εστίαση της Apple στις εξελίξεις στην υπολογιστική φωτογραφία.

Τα τελευταία χρόνια, αυτό έχει γίνει ένας ολοένα και πιο σημαντικός τομέας ενδιαφέροντος σε ολόκληρη την αγορά smartphone, καθώς οι πελάτες απαιτούν δυνατότητες κάμερας που υπερβαίνουν αυτές που μπορούν να χωρέσουν οι εταιρείες στις συσκευές τους.

Για να διαβάσετε την πλήρη μελέτη και να ελέγξετε πρόσθετες συγκρίσεις μεταξύ του DarkDiff και άλλων μεθόδων αφαίρεσης θορύβων, ακολουθήστε αυτόν τον σύνδεσμο.

Προσφορές αξεσουάρ στο Amazon

FTC: Χρησιμοποιούμε συνδέσμους θυγατρικών που κερδίζουν αυτόματα εισόδημα. Περισσότερο.

Via: 9to5mac.com