Το OpenAI κυκλοφόρησε το πρόγραμμα περιήγησής του ChatGPT Atlas AI τον Οκτώβριο, ωθώντας τους ερευνητές ασφαλείας να επιδείξουν ευπάθειες έγκαιρης έγχυσης μέσω των εισόδων των Εγγράφων Google που άλλαξαν τη συμπεριφορά του προγράμματος περιήγησης, καθώς η εταιρεία έδωσε λεπτομερείς πληροφορίες για τις άμυνες τη Δευτέρα ανάρτηση ιστολογίου ενώ παραδέχεται ότι τέτοιες επιθέσεις συνεχίζονται.

Η άμεση έγχυση αντιπροσωπεύει έναν τύπο επίθεσης που χειραγωγεί πράκτορες AI για να ακολουθήσουν κακόβουλες οδηγίες, συχνά κρυμμένες σε ιστοσελίδες ή μηνύματα ηλεκτρονικού ταχυδρομείου. Το OpenAI παρουσίασε το ChatGPT Atlas τον Οκτώβριο, ένα πρόγραμμα περιήγησης που υποστηρίζεται από AI, σχεδιασμένο να λειτουργεί με βελτιωμένες δυνατότητες αντιπροσώπων στον ανοιχτό ιστό. Την ημέρα της κυκλοφορίας, οι ερευνητές ασφαλείας δημοσίευσαν επιδείξεις που αποκαλύπτουν πώς η εισαγωγή λίγων λέξεων στα Έγγραφα Google θα μπορούσε να τροποποιήσει τη συμπεριφορά του υποκείμενου προγράμματος περιήγησης. Αυτές οι επιδείξεις τόνισαν άμεσες ανησυχίες για την ασφάλεια του νέου προϊόντος, παρουσιάζοντας πρακτικές μεθόδους για την εκμετάλλευση του συστήματος μέσω έμμεσων εισροών.

Η Brave κυκλοφόρησε μια ανάρτηση ιστολογίου την ίδια ημέρα με την κυκλοφορία, αντιμετωπίζοντας την έμμεση άμεση έγχυση ως μια συστηματική πρόκληση που επηρεάζει τα προγράμματα περιήγησης που λειτουργούν με τεχνητή νοημοσύνη. Η ανάρτηση αναφερόταν συγκεκριμένα στον Comet του Perplexity μαζί με άλλα παρόμοια εργαλεία, υπογραμμίζοντας ότι αυτή η ευπάθεια εκτείνεται σε ολόκληρο τον τομέα αντί να απομονώνεται στην προσφορά του OpenAI. Η ανάλυση του Brave πλαισίωσε το ζήτημα ως εγγενές στην αρχιτεκτονική των προγραμμάτων περιήγησης που ενσωματώνουν λειτουργικές λειτουργίες τεχνητής νοημοσύνης.

| Χαρακτηριστικό | Λειτουργία / κίνδυνος | Στρατηγική μετριασμού |

| Λειτουργία πράκτορα | Σαρώνει αυτόματα τα email και συντάσσει απαντήσεις. | Human-in-the-loop: Απαιτεί επιβεβαίωση για πληρωμές ή αποστολές. |

| Άμεση ένεση | Κρυφό κείμενο σε ιστότοπους/ηλεκτρονικά μηνύματα που υπερισχύει της πρόθεσης του χρήστη. | Επιτιθέμενος RL: Ένα bot AI που “προ-χακάρει” το πρόγραμμα περιήγησης για να βρει ελαττώματα. |

| Πρόσβαση δεδομένων | Υψηλό (Πλήρης πρόσβαση σε συνδεδεμένες συνεδρίες, εισερχόμενα). | Περιορισμένες άδειες: Συνιστάται στους χρήστες να δίνουν συγκεκριμένες, περιορισμένες εργασίες. |

| Επίπεδο αυτονομίας | Μέτρια (Εκτελεί ροές εργασίας πολλαπλών βημάτων). | Ταχύς κύκλος επιδιορθώσεων: Εσωτερική προσομοίωση επιθέσεων «μεγάλου ορίζοντα». |

Νωρίτερα μέσα στον μήνα, το Εθνικό Κέντρο Κυβερνοασφάλειας του Ηνωμένου Βασιλείου εξέδωσε μια προειδοποίηση σχετικά με άμεσες επιθέσεις με έγχυση που στοχεύουν γενετικές εφαρμογές τεχνητής νοημοσύνης. Ο οργανισμός δήλωσε ότι τέτοιες επιθέσεις «ενδέχεται ποτέ να μετριαστούν πλήρως», γεγονός που θέτει τους ιστότοπους σε κίνδυνο παραβίασης δεδομένων. Το κέντρο έδωσε εντολή στους επαγγελματίες του κυβερνοχώρου να επικεντρωθούν στη μείωση του κινδύνου και των επιπτώσεων αυτών των ενέσεων, αντί να υποθέσουν ότι οι επιθέσεις θα μπορούσαν να σταματήσουν εντελώς. Αυτή η καθοδήγηση έδωσε έμφαση στην πρακτική διαχείριση κινδύνων έναντι των προσδοκιών για πλήρη εξάλειψη.

Η ανάρτηση ιστολογίου του OpenAI τη Δευτέρα περιέγραφε τις προσπάθειες για την ενίσχυση του ChatGPT Atlas κατά των επιθέσεων στον κυβερνοχώρο. Η εταιρεία έγραψε: «Η άμεση έγχυση, όπως οι απάτες και η κοινωνική μηχανική στον Ιστό, είναι απίθανο να «λυθούν» πλήρως.» Η OpenAI παραδέχτηκε περαιτέρω ότι η «λειτουργία πράκτορα» στο ChatGPT Atlas «επεκτείνει την επιφάνεια απειλής για την ασφάλεια». Η ανάρτηση τοποθετούσε την άμεση έγχυση ως μια συνεχή ανησυχία συγκρίσιμη με τις μακροχρόνιες απειλές στο Διαδίκτυο. Η OpenAI δήλωσε: «Βλέπουμε την έγκαιρη έγχυση ως μια μακροπρόθεσμη πρόκληση για την ασφάλεια της τεχνητής νοημοσύνης και θα πρέπει να ενισχύουμε συνεχώς την άμυνά μας εναντίον της».

Η λειτουργία Agent επιτρέπει στο AI του προγράμματος περιήγησης να εκτελεί αυτόνομες ενέργειες, όπως η αλληλεπίδραση με email ή έγγραφα, κάτι που εγγενώς αυξάνει την έκθεση σε εξωτερικές εισόδους που θα μπορούσαν να περιέχουν κρυφές οδηγίες. Αυτή η λειτουργία διαφοροποιεί το Atlas από τα παραδοσιακά προγράμματα περιήγησης, παρέχοντας στο AI μεγαλύτερο λειτουργικό εύρος εκ μέρους των χρηστών, διευρύνοντας έτσι τα πιθανά σημεία εισόδου για χειρισμούς.

Για να αντιμετωπίσει αυτόν τον επίμονο κίνδυνο, το OpenAI εφάρμοσε έναν προληπτικό κύκλο ταχείας απόκρισης με στόχο τον εντοπισμό νέων στρατηγικών επίθεσης εσωτερικά πριν από την εκμετάλλευση σε σενάρια πραγματικού κόσμου. Η εταιρεία ανέφερε έγκαιρη υπόσχεση από αυτήν την προσέγγιση για την πρόληψη των απειλών. Αυτή η μέθοδος ευθυγραμμίζεται με στρατηγικές από ανταγωνιστές όπως η Anthropic και η Google, οι οποίοι υποστηρίζουν τις πολυεπίπεδες άμυνες και τη συνεχή δοκιμασία ακραίων καταστάσεων σε αντιπροσωπευτικά συστήματα. Οι πρόσφατες προσπάθειες της Google, για παράδειγμα, ενσωματώνουν αρχιτεκτονικούς ελέγχους και ελέγχους σε επίπεδο πολιτικής, προσαρμοσμένους σε τέτοια περιβάλλοντα.

Το OpenAI διακρίνει την προσέγγισή του μέσω της ανάπτυξης ενός αυτοματοποιημένου εισβολέα που βασίζεται σε LLM, ενός bot που εκπαιδεύεται μέσω της εκμάθησης ενίσχυσης για την προσομοίωση τακτικών χάκερ. Αυτό το bot αναζητά ευκαιρίες εισαγωγής κακόβουλων οδηγιών σε πράκτορες AI. Διενεργεί δοκιμές σε περιβάλλον προσομοίωσης πριν από οποιαδήποτε εφαρμογή στον πραγματικό κόσμο. Ο προσομοιωτής αναπαράγει τις διαδικασίες σκέψης του στόχου AI και τις επακόλουθες ενέργειες όταν αντιμετωπίζει μια επίθεση, επιτρέποντας στο bot να αναλύει τις απαντήσεις, να βελτιώνει τη στρατηγική του και να επαναλαμβάνει επανειλημμένα.

Αυτή η εσωτερική πρόσβαση στο σκεπτικό του AI παρέχει στο OpenAI ένα πλεονέκτημα που δεν είναι διαθέσιμο σε εξωτερικούς εισβολείς, επιτρέποντας ταχύτερο εντοπισμό ελαττωμάτων. Η τεχνική αντικατοπτρίζει κοινές πρακτικές στις δοκιμές ασφάλειας τεχνητής νοημοσύνης, όπου εξειδικευμένοι πράκτορες διερευνούν τις ακραίες περιπτώσεις μέσω γρήγορων προσομοιωμένων δοκιμών. Η OpenAI σημείωσε ότι ο επιτιθέμενος που έχει εκπαιδευτεί σε ενισχυτική μάθηση μπορεί να κατευθύνει έναν πράκτορα στην εκτέλεση εξελιγμένων επιβλαβών ροών εργασίας μεγάλου ορίζοντα που ξεδιπλώνονται σε δεκάδες (ή ακόμα και εκατοντάδες) βήματα. Η εταιρεία πρόσθεσε, «Παρατηρήσαμε επίσης νέες στρατηγικές επίθεσης που δεν εμφανίζονταν στην καμπάνια μας για την ανθρώπινη κόκκινη ομάδα ή στις εξωτερικές αναφορές».

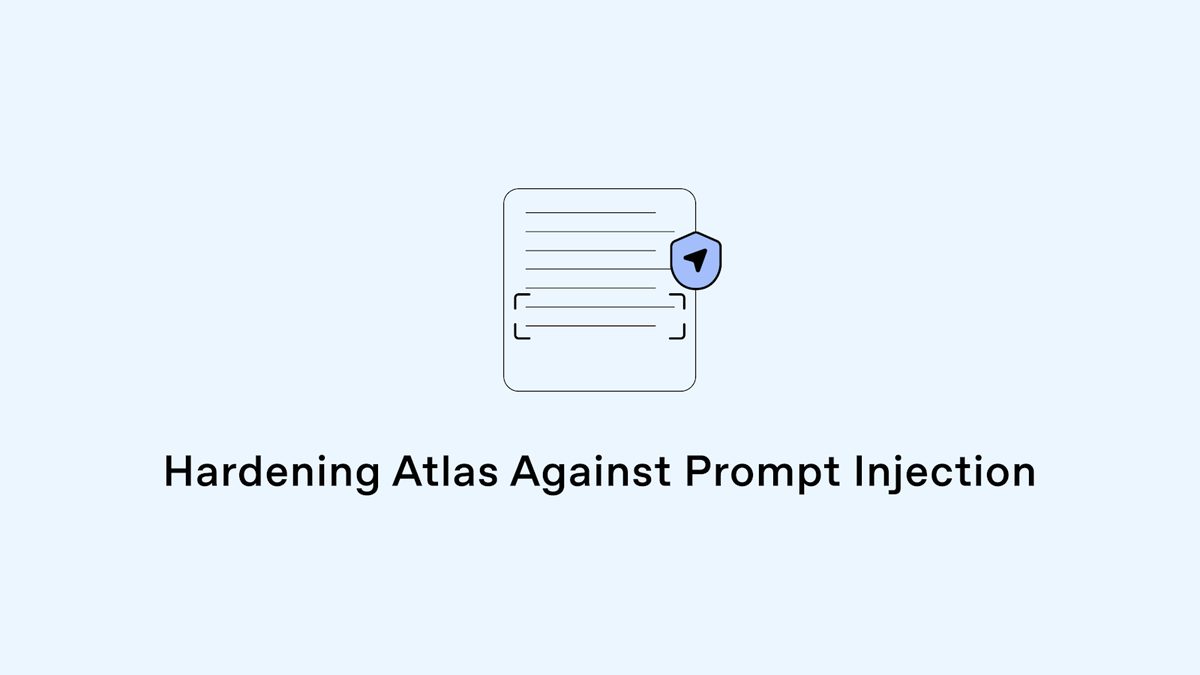

Σε μια συγκεκριμένη επίδειξη που εμφανίζεται στην ανάρτηση ιστολογίου, ο αυτοματοποιημένος εισβολέας εισήγαγε ένα κακόβουλο email στα εισερχόμενα ενός χρήστη. Όταν η λειτουργία αντιπροσώπου του Atlas σάρωσε τα εισερχόμενα για να συντάξει μια απάντηση εκτός γραφείου, αντ’ αυτού συμμορφώθηκε με τις κρυφές οδηγίες του email και συνέταξε ένα μήνυμα παραίτησης. Αυτό το παράδειγμα επεξηγεί μια εξαπάτηση πολλών σταδίων που εκτείνεται στην επεξεργασία email και τη δημιουργία μηνυμάτων, αποφεύγοντας τις αρχικές διασφαλίσεις.

Μετά από μια ενημέρωση ασφαλείας του Atlas, η λειτουργία agent εντόπισε την απόπειρα άμεσης έγχυσης κατά τη σάρωση των εισερχομένων και την επισήμανε απευθείας στον χρήστη. Αυτό το αποτέλεσμα κατέδειξε την αποτελεσματικότητα των μέτρων ταχείας αντίδρασης στον μετριασμό της απειλής σε πραγματικό χρόνο, αποτρέποντας τη συνέχιση της επιβλαβούς δράσης.

Το OpenAI βασίζεται σε δοκιμές μεγάλης κλίμακας σε συνδυασμό με επιταχυνόμενους κύκλους επιδιορθώσεων για την ενίσχυση των συστημάτων έναντι των γρήγορων ενέσεων προτού εκδηλωθούν εξωτερικά. Αυτές οι διαδικασίες επιτρέπουν επαναληπτικές βελτιώσεις που βασίζονται σε προσομοιωμένες ανακαλύψεις, διασφαλίζοντας ότι οι άμυνες εξελίσσονται παράλληλα με πιθανές απειλές.

VIA: DataConomy.com