Οι ερευνητές της Apple δημοσίευσαν μια μελέτη για το Manzano, ένα πολυτροπικό μοντέλο που συνδυάζει οπτική κατανόηση και δημιουργία κειμένου σε εικόνα, ενώ μειώνει σημαντικά την απόδοση και την ποιότητα των συμβιβασμών των τρεχουσών υλοποιήσεων. Εδώ είναι οι λεπτομέρειες.

Μια ενδιαφέρουσα προσέγγιση σε ένα πρόβλημα τελευταίας τεχνολογίας

Στη μελέτη με τίτλο MANZANO: Ένα απλό και επεκτάσιμο ενοποιημένο πολυτροπικό μοντέλο με υβριδικό σύστημα μάρκετινγκμια ομάδα σχεδόν 30 ερευνητών της Apple περιγράφει λεπτομερώς μια νέα ενοποιημένη προσέγγιση που επιτρέπει τόσο την κατανόηση εικόνας όσο και τη δημιουργία κειμένου σε εικόνα σε ένα ενιαίο πολυτροπικό μοντέλο.

Αυτό είναι σημαντικό επειδή τα τρέχοντα ενοποιημένα πολυτροπικά μοντέλα που υποστηρίζουν τη δημιουργία εικόνων συχνά αντιμετωπίζουν συμβιβασμούς: είτε θυσιάζουν την οπτική κατανόηση για να δώσουν προτεραιότητα στη δημιουργία αυτοπαλινδρομικής εικόνας είτε δίνουν προτεραιότητα στην κατανόηση, θυσιάζοντας τη γενετική πιστότητα. Με άλλα λόγια, συχνά αγωνίζονται να διαπρέψουν και στα δύο ταυτόχρονα.

Να γιατί συμβαίνει αυτό, σύμφωνα με τους ερευνητές:

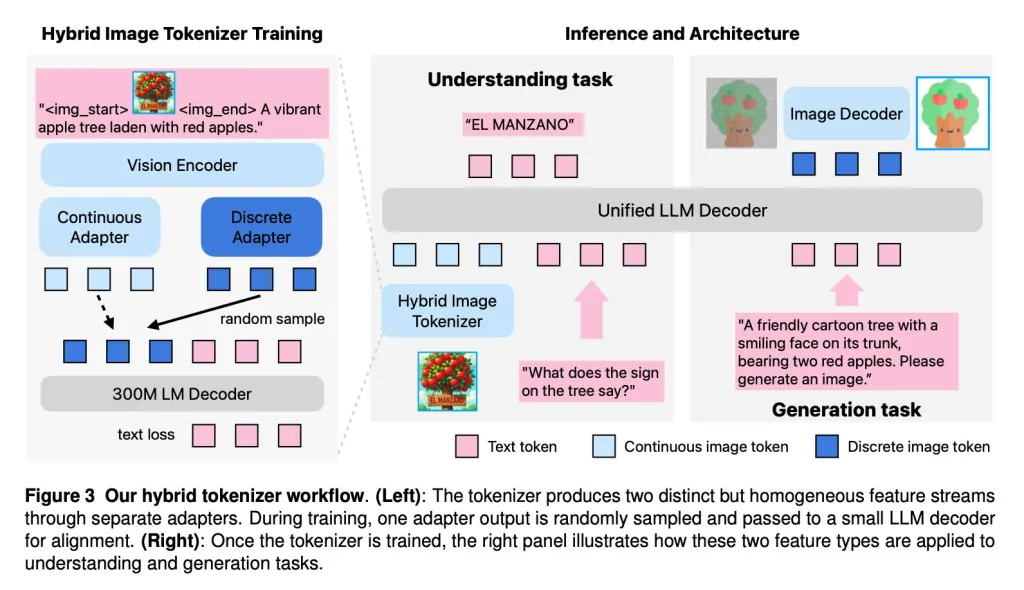

Ένας βασικός λόγος για αυτό το κενό είναι η αντικρουόμενη φύση του οπτικού συμβολισμού. Η δημιουργία αυτόματης παλινδρόμησης συνήθως προτιμά διακριτά διακριτικά εικόνας, ενώ η κατανόηση συνήθως επωφελείται από τις συνεχείς ενσωματώσεις. Πολλά μοντέλα υιοθετούν μια στρατηγική dual-tokenizer, χρησιμοποιώντας έναν σημασιολογικό κωδικοποιητή για πλούσια, συνεχή χαρακτηριστικά, ενώ ένας ξεχωριστός κβαντισμένος tokenizer όπως το VQ-VAE χειρίζεται τη δημιουργία. Ωστόσο, αυτό αναγκάζει το γλωσσικό μοντέλο να επεξεργαστεί δύο διαφορετικούς τύπους διακριτικών εικόνας, έναν από σημασιολογικό χώρο υψηλού επιπέδου έναντι ενός από χωρικό χώρο χαμηλού επιπέδου, δημιουργώντας μια σημαντική σύγκρουση εργασιών. Ενώ ορισμένες λύσεις όπως το Mixture-of-Transformers (MoT) μπορούν να το μετριάσουν αφιερώνοντας ξεχωριστές διαδρομές για κάθε εργασία, είναι αναποτελεσματικές ως προς τις παραμέτρους και συχνά δεν είναι συμβατές με τις σύγχρονες αρχιτεκτονικές Mixture-of-Experts (MoE). Μια εναλλακτική γραμμή εργασίας παρακάμπτει αυτή τη σύγκρουση παγώνοντας ένα προεκπαιδευμένο πολυτροπικό LLM και συνδέοντάς το με έναν αποκωδικοποιητή διάχυσης. Ενώ αυτό διατηρεί την ικανότητα κατανόησης, αποσυνδέει την παραγωγή, χάνοντας πιθανά αμοιβαία οφέλη και περιορίζοντας τα πιθανά κέρδη για την παραγωγή από την κλιμάκωση του πολυτροπικού LLM.

Με απλά λόγια, οι τρέχουσες πολυτροπικές αρχιτεκτονικές δεν είναι κατάλληλες για την εκτέλεση και των δύο εργασιών ταυτόχρονα επειδή βασίζονται σε αντικρουόμενες οπτικές αναπαραστάσεις για την κατανόηση και τη δημιουργία, τις οποίες το ίδιο γλωσσικό μοντέλο αγωνίζεται να συμβιβάσει.

Εκεί μπαίνει ο Manzano. Ενοποιεί εργασίες κατανόησης και δημιουργίας χρησιμοποιώντας ένα αυτοπαλινδρομικό LLM για να προβλέψει τι πρέπει να περιέχει η εικόνα σημασιολογικά, και μετά μεταβιβάζει αυτές τις προβλέψεις σε έναν αποκωδικοποιητή διάχυσης (η διαδικασία αποθορυβοποίησης που εξηγήσαμε εδώ) που αποδίδει τα πραγματικά pixel.

Όπως εξηγούν οι ερευνητές, το Manzano συνδυάζει τρία στοιχεία στην αρχιτεκτονική του:

- Ένα υβριδικό tokenizer όρασης που παράγει τόσο συνεχείς όσο και διακριτές οπτικές αναπαραστάσεις.

- Ένας αποκωδικοποιητής LLM που δέχεται διακριτικά κειμένου και/ή συνεχείς ενσωματώσεις εικόνων και προβλέπει αυτόματα παλινδρομικά την επόμενη διακριτή εικόνα ή διακριτικά κειμένου από ένα κοινό λεξιλόγιο.

- Ένας αποκωδικοποιητής εικόνας που αποδίδει εικονοστοιχεία εικόνας από προβλεπόμενα διακριτικά εικόνας

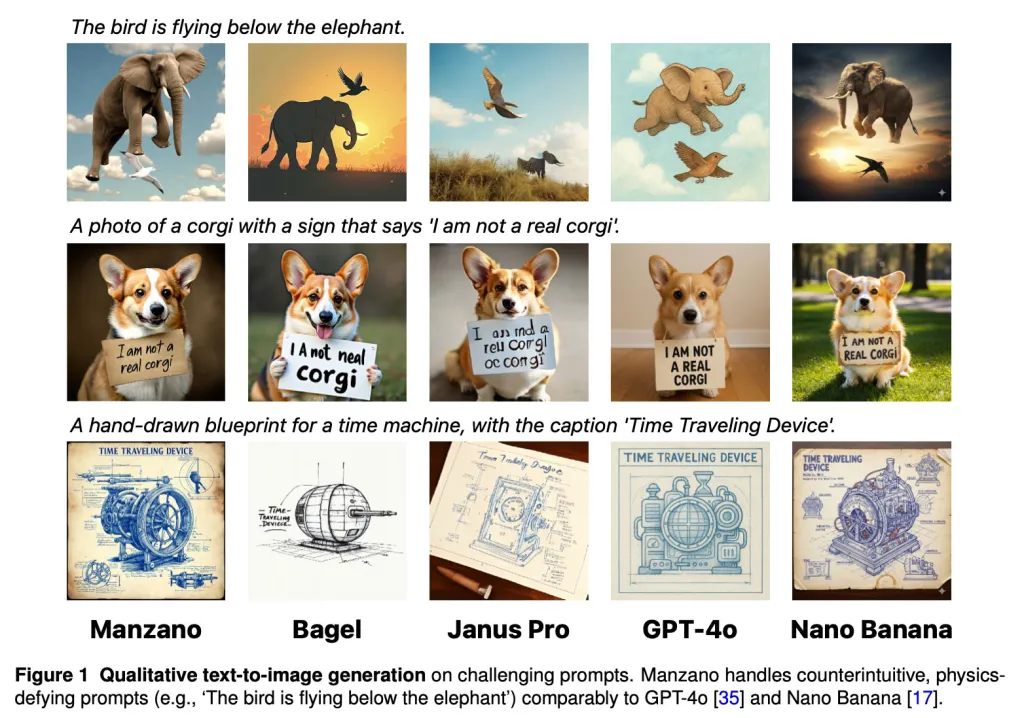

Ως αποτέλεσμα αυτής της προσέγγισης, «ο Manzano χειρίζεται αντιδιαισθητικές προτροπές που αψηφούν τη φυσική (π.χ. «Το πουλί πετά κάτω από τον ελέφαντα») σε σύγκριση με το GPT-4o και το Nano Banana», λένε οι ερευνητές.

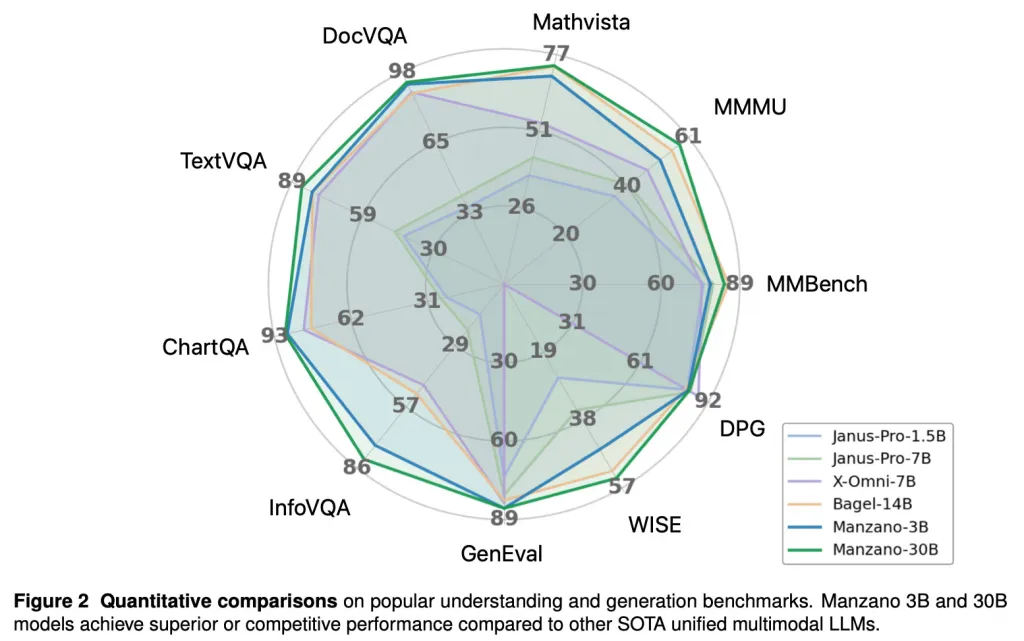

Οι ερευνητές σημειώνουν επίσης ότι σε πολλαπλά σημεία αναφοράς, «τα μοντέλα Manzano 3B και 30B επιτυγχάνουν ανώτερη ή ανταγωνιστική απόδοση σε σύγκριση με άλλα ενοποιημένα πολυτροπικά LLM SOTA».

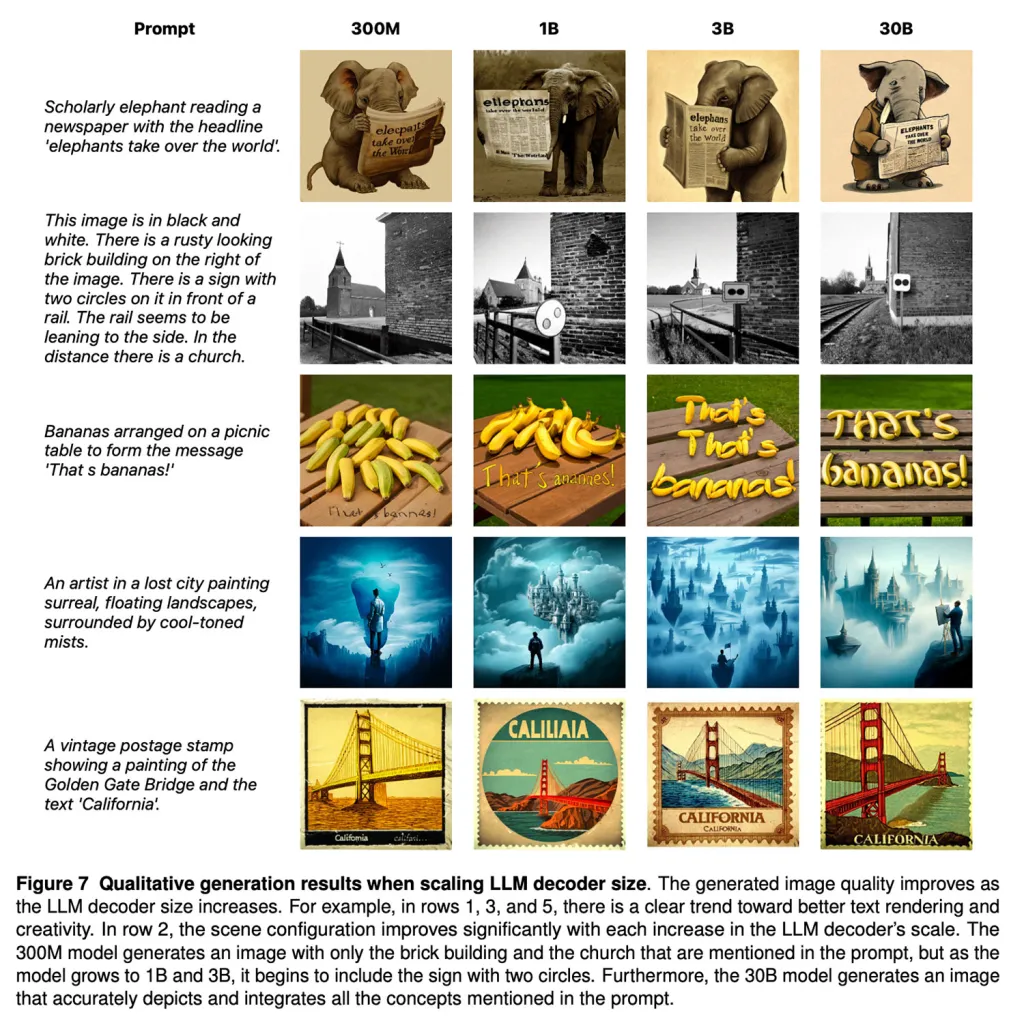

Οι ερευνητές της Apple δοκίμασαν το Manzano σε διάφορα μεγέθη, από ένα μοντέλο παραμέτρων 300M έως μια έκδοση παραμέτρων 30B. Αυτό τους επέτρεψε να αξιολογήσουν πώς βελτιώνεται η ενοποιημένη πολυτροπική απόδοση καθώς κλιμακώνεται το μοντέλο:

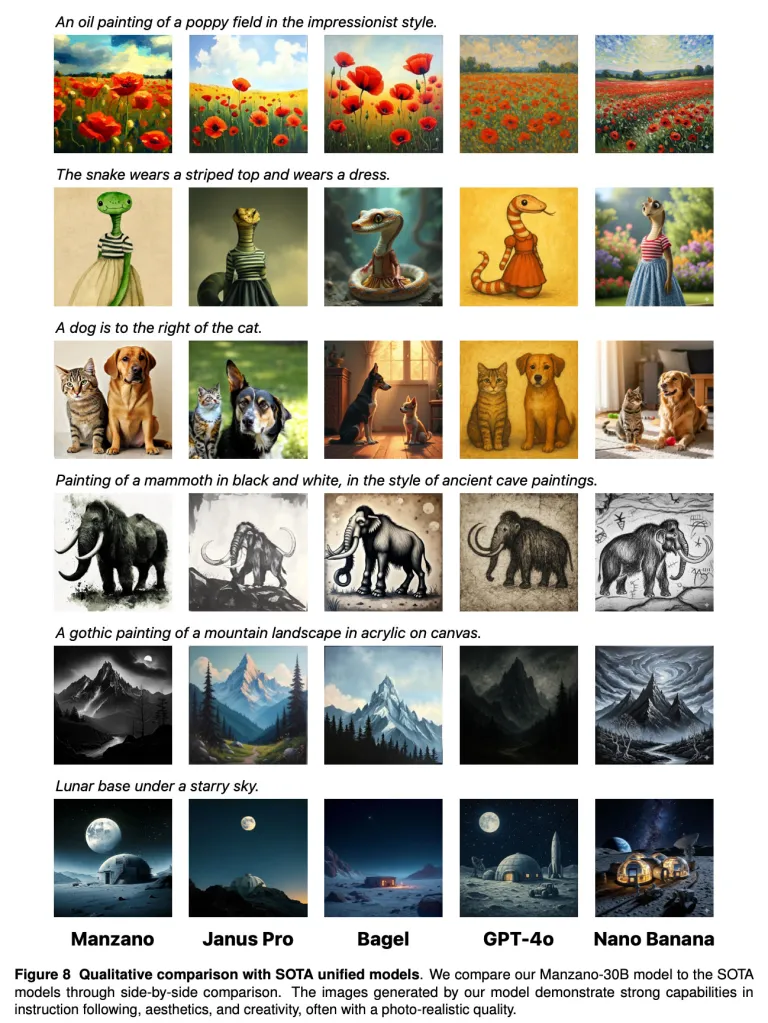

Ακολουθεί μια άλλη σύγκριση μεταξύ του Manzano και άλλων μοντέλων τελευταίας τεχνολογίας, συμπεριλαμβανομένου του Nano Banana της Google και του GPT-4o του OpenAI:

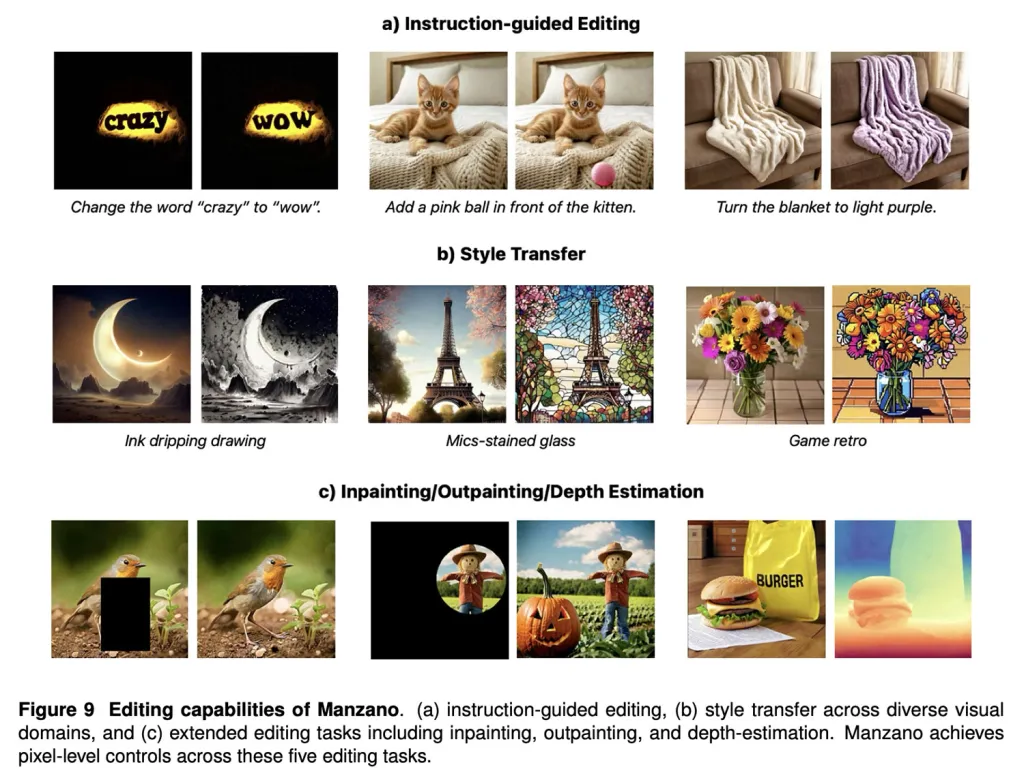

Τέλος, ο Manzano αποδίδει επίσης καλά σε εργασίες επεξεργασίας εικόνας, συμπεριλαμβανομένης της επεξεργασίας καθοδηγούμενης από οδηγίες, της μεταφοράς στυλ, της εσωτερικής ζωγραφικής/εξωτερικής ζωγραφικής και της εκτίμησης βάθους.

Για να διαβάσετε την πλήρη μελέτη, με σε βάθος τεχνικές λεπτομέρειες σχετικά με την εκπαίδευση υβριδικού tokenizer του Manzano, τον σχεδιασμό αποκωδικοποιητή διάχυσης, τα πειράματα κλιμάκωσης και τις αξιολογήσεις ανθρώπων, ακολουθήστε αυτόν τον σύνδεσμο.

Και αν ενδιαφέρεστε για αυτό το θέμα, φροντίστε να δείτε την επεξήγηση μας στο UniGen, ένα ακόμη πολλά υποσχόμενο μοντέλο εικόνας που οι ερευνητές της Apple εξέδωσαν πρόσφατα. Αν και κανένα από αυτά τα μοντέλα δεν είναι άμεσα διαθέσιμο σε συσκευές Apple, προτείνουν συνεχή εργασία για ισχυρότερα αποτελέσματα πρώτης γενιάς εικόνων στο Image Playground και πέρα από αυτό.

Προσφορές αξεσουάρ στο Amazon

Via: 9to5mac.com