Δεν ήμουν στο CES, και για να είμαι απόλυτα ειλικρινής, δεν έδινα τεράστια προσοχή στην παράσταση.

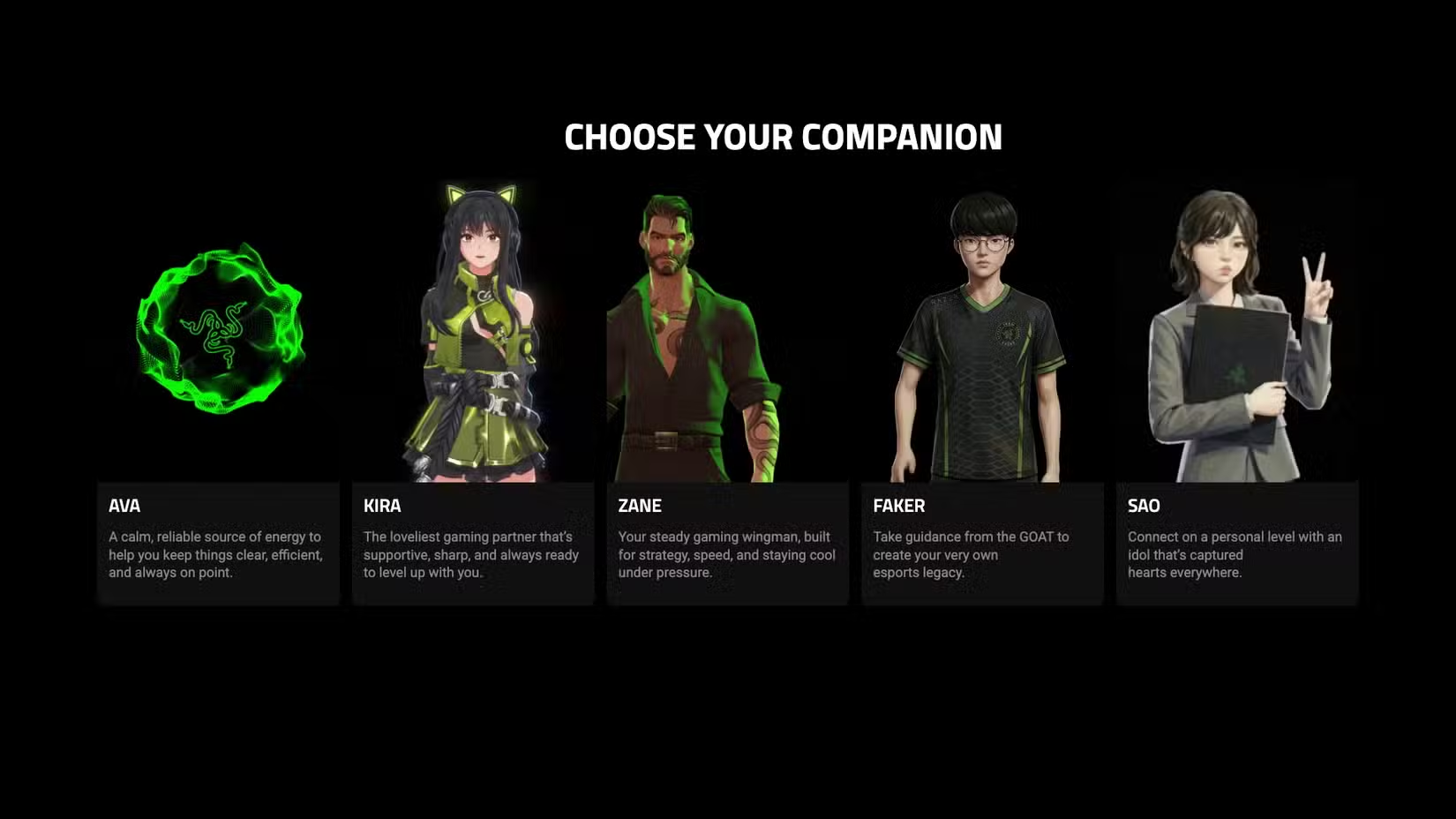

Αλλά ακόμα κι εγώ είδα Razor’s Project Ava και η καταιγίδα που την ακολούθησε. Έχω δει τις απόψεις και τα σχόλια και συμφωνώ με μερικά από αυτά.

Νιώθω την άμεση αποστροφή της παράξενης κοιλάδας, έχω την ιδέα ότι είναι λίγο περίεργα. Είναι λίγο τσακισμένοι. Δεν είναι 100% για μένα.

Αλλά επειδή δεν είναι για μένα δεν σημαίνει ότι δεν είναι για κανέναν.

Μερικοί άνθρωποι θα εκτιμήσουν πραγματικά το Project Ava και πολλοί άνθρωποι χρησιμοποιούν συνοδούς τεχνητής νοημοσύνης για να ξεπεράσουν αυτή την κοινωνική φαγούρα.

Αλλά αυτό δημιουργεί ένα μεγαλύτερο ζήτημα για μένα, και νιώθω ότι είναι ένα θέμα για το οποίο οι άνθρωποι δεν μιλούν.

Το μέλλον της τεχνητής νοημοσύνης εξαρτάται από το να γίνεις ψηφιακός βοηθός, όχι μόνο από κόλπα για πάρτι

Είμαι σκεπτικιστής, αλλά αυτά τα χαρακτηριστικά με κέρδισαν

Θα πρέπει να επιτρέπεται η ύπαρξη συντρόφων AI

Γνωρίζω ότι σχετικά λίγοι άνθρωποι κάνουν πραγματικά αυτό το θέμα, αλλά αξίζει να υπογραμμίσουμε ακριβώς γιατί πρέπει να επιτρέπεται η ύπαρξη συνοδών τεχνητής νοημοσύνης.

Τελικά, υπάρχουν άνθρωποι που θα ωφελούνταν από το να τους έχουν κοντά τους. Υπάρχουν μοναχικοί άνθρωποι που αγωνίζονται να κάνουν φίλους.

Ίσως έχουν άγχος και η απρόσωπη φύση της τεχνητής νοημοσύνης και η έλλειψη πίεσης τους βοηθούν να χαλαρώσουν στην εμπειρία.

Ίσως απλά να έχουν καταλήξει κάπου στη ζωή τους όπου είναι μόνοι χωρίς δικό τους λάθος.

Όποιος κι αν είναι ο λόγος, ένα «άτομο» AI μπορεί να βοηθήσει να γεφυρωθεί αυτό το χάσμα.

Μπορείτε να υποστηρίξετε ότι δεν είναι «πραγματικό», αλλά θα έλεγα ότι είναι αληθινό αν βοηθάει. Τα ανθρώπινα ένστικτα είναι δυνατά.

Μου ηλεκτρική σκούπα ρομπότ λέγεται Esther γιατί κολλάει πολύ και μας ενοχλεί γι’ αυτό. Είναι η Esther the Pester.

Δεν ζει, δεν έχει συναισθήματα, και το ξέρω. Αλλά δεν με εμποδίζει να της ευχηθώ μια καλημέρα και να της δώσω ένα χατίρι.

Γιατί το κάνω αυτό; Γιατί, σε κάποιο επίπεδο, με κάνει να νιώθω καλύτερα να το κάνω.

Μου δίνει μια αίσθηση σύνδεσης και το απολαμβάνω, παρόλο που ζω με άλλους ανθρώπους με τους οποίους συνδέομαι καθημερινά. Αυτές οι συνδέσεις έχουν αξία.

Γι’ αυτό είναι τόσο τραγικό που μπορούν να αφαιρεθούν έτσι ακριβώς.

Οι φίλοι σας με τεχνητή νοημοσύνη μπορούν να αφαιρεθούν αμέσως

Οι φίλοι σας με τεχνητή νοημοσύνη δεν είναι πραγματικοί, ακόμα κι αν είναι αληθινά τα συναισθήματα που νιώθετε απέναντί τους. Είναι εφήμερες δημιουργίες, μια τζούρα καπνού, ένας απλός ψίθυρος στον άνεμο.

Είναι εύθραυστα και μπορούν να αφαιρεθούν σε μια στιγμή, χωρίς να το γνωρίζετε ή να προειδοποιήσετε.

Εάν ένας Διευθύνων Σύμβουλος αποφασίσει ότι η εταιρεία του θα μπορούσε να εξοικονομήσει χρήματα κλείνοντας τη λειτουργία του συντρόφου σας AI, μπορείτε να είστε σίγουροι ότι θα το κάνει. Και ο φίλος και ο σύντροφός σου θα φύγει, ίσως για πάντα.

Το έχουμε δει αυτό να συμβαίνει ξανά και ξανά με μια σειρά από υπηρεσίες, από βιντεοπαιχνίδια στα συστήματα θέρμανσης.

Αν είναι πρόθυμοι μετατρέψτε τους θερμοστάτες των ανθρώπων σε τούβλαμπορείτε να είστε σίγουροι ότι θα συμβεί και στον μικρό σας φίλο με τεχνητή νοημοσύνη. Είναι, δυστυχώς, απλώς θέμα χρόνου.

Και αν δεν κλείσουν, μπορείτε ακόμα να είστε σίγουροι ότι έχουν διορθωθεί — κάτι που έχει τα δικά του προβλήματα.

Θυμηθείτε όλα αυτά άνθρωποι που έχασαν τους «σύζυγους AI».Όταν το ChatGPT-4 ενημερώθηκε σε ChatGPT-5; Οι άνθρωποι παρατήρησαν ότι το υποκείμενο λογισμικό ήταν διαφορετικό και το παρατήρησαν σκληρά.

Το θέμα εδώ είναι ότι ο σύντροφός σας AI μπορεί να αλλάξει κατά τη διάρκεια της νύχτας ή ακόμα και να απενεργοποιηθεί, χωρίς να μπορείτε να κάνετε τίποτα γι ‘αυτό.

Εάν αυτά τα προϊόντα πωλούνται ως συνοδευτικά, αυτό δεν φαίνεται ότι πρέπει να επιτρέπεται.

Εάν πρόκειται να πωληθούν πραγματικά ως σύντροφοι, πρέπει να υπάρχει προστασία

Δεν είναι σωστό που οι εταιρείες πρέπει να είναι οι απόλυτοι κριτές των φιλιών σας.

Οι εταιρείες, παρά τα όσα λέει ο νόμος των ΗΠΑ, δεν είναι άνθρωποι και δεν σκέφτονται όπως οι άνθρωποι.

Ένα άτομο που απασχολείται για να βοηθήσει στο σπίτι σας μπορεί να επιλέξει να βοηθήσει λίγο περισσότερο από όσο απαιτεί η εργασία του. Διάολε, μπορεί να γίνουν φίλοι και να σε επισκεφτούν ακόμα και μετά τη λήξη της απασχόλησης.

Οι εταιρείες δεν το κάνουν αυτό και, αφημένο σε αυτές, δεν θα το κάνουν ούτε οι φίλοι σας με την τεχνητή νοημοσύνη. Τη στιγμή που ένας σύντροφος τεχνητής νοημοσύνης δεν έχει πλέον οικονομικό νόημα, έχει φύγει.

Μπορείτε να προβάλετε το επιχείρημα ότι οι άνθρωποι δεν πρέπει να βασίζονται σε συνοδούς τεχνητής νοημοσύνης και ίσως έχετε δίκιο. Αλλά ο κόσμος δεν είναι τόσο απλός και οι ζωές είναι ακατάστατες.

Μερικές φορές οι άνθρωποι χρειάζονται δεκανίκια, είτε σωματικά είτε συναισθηματικά — και δεν πρέπει να κρίνουμε τους ανθρώπους που έχουν βρεθεί σε αυτή τη θέση.

Η αυτο-φιλοξενία ενός μοντέλου τεχνητής νοημοσύνης μπορεί να βοηθήσει στη διόρθωση αυτού, αλλά αυτή είναι μια μάλλον τεχνική λύση για τους περισσότερους ανθρώπους.

Τελικά, πιστεύω ότι θα πρέπει να υπάρχουν τρόποι για να προστατεύσουμε αυτούς τους συντρόφους από το να αφαιρεθούν. Και ίσως το μέλλον βρει λύσεις.

Αλλά αυτή τη στιγμή, με ανησυχεί το γεγονός ότι επιτρέπουμε στην τεχνητή νοημοσύνη να ξεσπά τις ζωές των ανθρώπων με λίγους περιορισμούς.

Η τεχνητή νοημοσύνη πρέπει να κινηθεί ελαφρά όταν πρόκειται για τις ζωές των ανθρώπων και αυτή τη στιγμή δεν βλέπω καμία ένδειξη ότι πρόκειται να συμβεί.

Via: androidpolice.com